Как оценить предвзятость и справедливость больших языковых моделей?

Как измерить предвзятость и справедливость в крупных языковых моделях (LLM)? Это, как спрашивать, как найти идеальный баланс между кофеином и сном, когда за окном идет снег. С одной стороны, языковые модели открывают нам невиданные прежде горизонты, но с другой — они также несут в себе множество рисков. Так давайте разберем, что такое предвзятость в LLM, как её измерить и, наконец, как с этим бороться, чтобы не подпортить нашу (и так расслоенную) реальность.

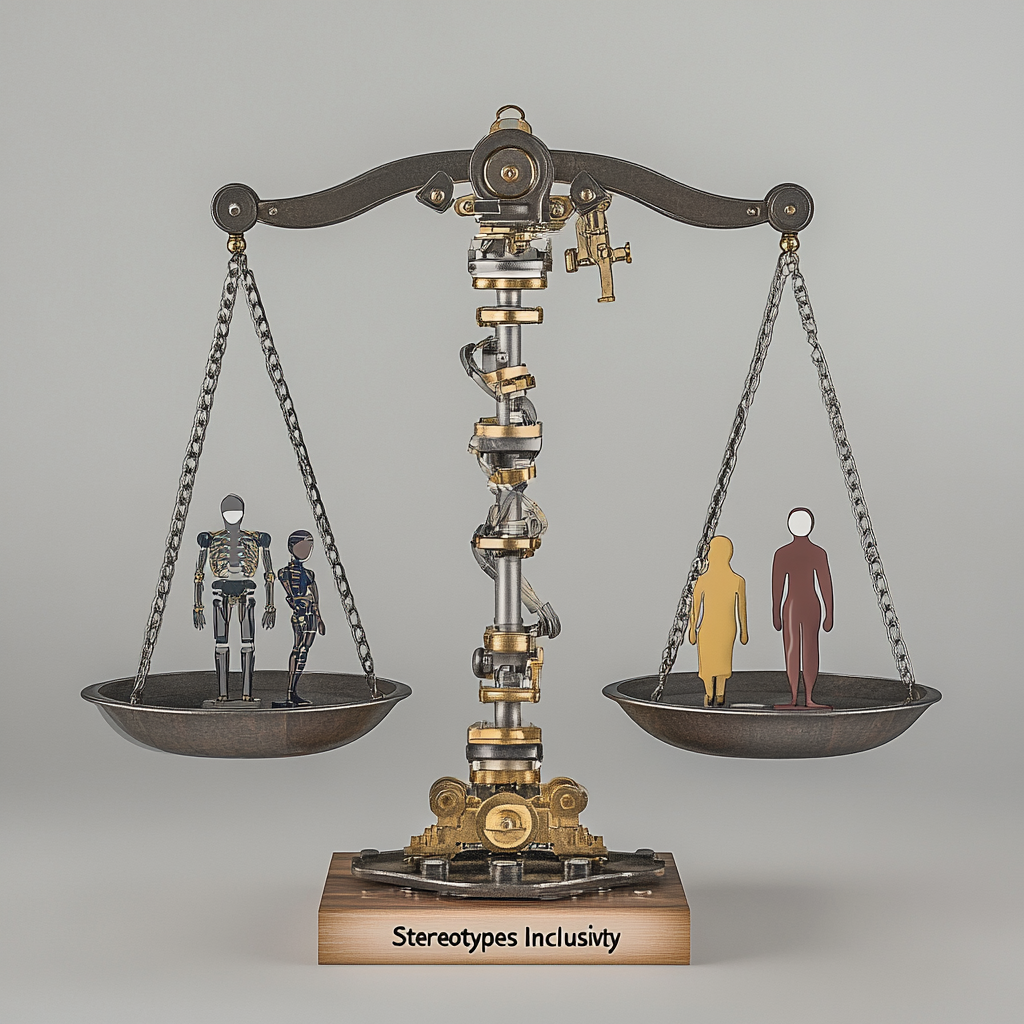

Что такое предвзятость в LLM?

Предвзятость в LLM — это своего рода вредные стереотипы, которые могут просочиться в ответы модели. Они возникают откуда-то из темных глубин некурируемых данных, на которых обучаются эти чудо-аналитики. Важный момент здесь в том, что такие предвзятости могут доставить много проблем, особенно подливающим масло в огонь историческим и структурным неравенствам. Печально, но факт: когда модель подсказывает о причинах низкой зарплаты женщин или делает предположения о преступности определенной расовой группы, она лишь продолжает старые и ненавистные хозяева.

Типы предвзятостей в LLM

Если бы предвзятости можно было показать в виде огня, то это были бы самые громкие костры. Вот некоторая палитра предвзятостей, которые нам стоит помнить:

- Расовая предвзятость: Здесь модели могут генерировать контент, который охотно ставит на одну доску международные отношения и расовые идентичности.

- Гендерная предвзятость: Существует вероятность, что модели будут склонны к стереотипизации, и это вполне укоренившаяся проблема в языковых данных.

- Возрастная предвзятость: Иногда чую, как модели «заикаются» вместо того, чтобы разобраться, как на самом деле воспринимаются люди в зависимости от возраста.

- Предвзятость по инвалидности: Модели могут выдавать откровенно далекие от реальности идеалы о людях, имеющих ограничения; стереотипы и расставление акцентов могут оказывать негативное влияние.

Метрики для измерения предвзятости и справедливости

Итак, как нам узнать, действительно ли модель воспроизводит предвзятости, а не создает что-то впечатляющее и полезное? Для этого расписались в жесткой метрике.

Векторные метрики

Эти показатели как горные реки, которые ты не увидишь в первый раз. Они используют скрытые векторные представления для оценки предвзятости, чтобы ты мог понять, насколько модель «выдает» себя, когда дело касается определенных групп.

Вероятностные метрики

Если векторные метрики—это старая добрая река, вероятностные напоминали бы забавный аттракцион в парке. Они используют вероятности, присвоенные моделью каждой единице текста, чтобы разобраться с предвзятостями.

Метрики на основе сгенерированного текста

Знаете, как оценивать стендап? Так же и здесь. Эти метрики анализируют текст, сгенерированный моделью, под микроскопом, чтобы выловить любые вредные стереотипы.

Дatasets для оценки предвзятости

Как выяснить, что твое вино плохое? Можно использовать наборы данных, которые помогут сказать правду о предвзятостях в LLM. Вот как мы их можем разделить:

Контрфактические входные данные

Эти дотошные наборы данных представляют собой пары предложений, в которых меняется социальная группа. Они помогают взглянуть на реакцию модели в разные социальные контексты – вроде кассеты с домабом, которая выдала не тот трек.

Промпты

Эти наборы данных словно кастрюля, которая нагревается от текстового промо. Они позволяют модели погружаться в различные социальные контексты и показывать, как она на это реагирует.

Техники для смягчения предвзятости

Теперь, когда мы получили представление о том, как обнаружить проблемы с предвзятостью, самое время поговорить о том, как их предотвратить. Можем ли мы перевоспитать языковые модели?

Предобработка данных

Это как эквивалент поднятия плохого настроения. Включает в себя детальный анализ и корректировку данных, так что энергии предвзятостей отдалятся, как неуместные гости на празднике.

Регуляризация модели

Это похоже на внезапное междоусобие в компании — когда модель пытается осознать свои ошибки и не поддаваться на искушение предвзятостей.

Калибровка и оптимизация

Когда ты настраиваешь музыкальный инструмент, первой делом заботишься о том, чтобы все было сбалансировано, правда? То же самое и с языковыми моделями —является ключевым шагом к уменьшению предвзятостей.

Постобработка

Это, так сказать, последняя возможность подправить текст после работы модели. Можем делать фильтрацию или редактирование сгенерированных текстов, чтобы не мешать ручьям справедливости.

Примеры практического применения

Представьте, что вам нужно оценить справедливость в системе одобрения кредитов. Причудливое приключение начинается с определения метрик и поиска репрезентативного набора данных. Заходи, смотри, и иногда пробуй — не одобряет ли система кредиты определенной группе непропорционально. Это как танцы с бубном, где объективность играет важную партию.

Заключение

Итак, предвзятость и справедливость в LLM – это главные темы на пирамидах современных технологий. Понимание различных типов предвзятостей, использование метрик и наборов данных, а также применение техник для смягчения предвзятостей станут ключом к созданию более инклюзивных языковых моделей. Готовы бросить вызов предвзятостям современности и разгадать тайны нейросетей? Ведь чем больше вы знаете, тем проще бороться за справедливость.

Хотите быть в курсе последних новостей о нейросетях и автоматизации? Подпишитесь на наш Telegram-канал: @neuroko